KontenPositif.com — Belakangan ini linimasa media sosial dipenuhi video pendek yang tampak nyata, meyakinkan, dan sangat viral—namun sebagian besar tidak pernah terjadi di dunia nyata. Fenomena ini bukan sekadar ledakan konten kreatif, tetapi gelombang baru rekayasa informasi berbasis kecerdasan buatan yang dihasilkan secara masif. Video yang memuat wajah tokoh publik yang sedang berbicara isu sensitif, atau klip yang menunjukkan pejabat mengeluarkan pernyataan kontroversial, kini dapat dibuat hanya dalam hitungan detik. Teknologi AI generatif menjadikan manipulasi informasi semakin murah, cepat, dan mampu diproduksi dalam skala pabrikan. Situasi ini menggeser cara masyarakat memahami kebenaran, sekaligus menciptakan ancaman serius bagi ruang publik digital.

Tren ini terasa semakin kuat di platform yang sangat mengutamakan distribusi video pendek seperti TikTok, YouTube Shorts, dan Instagram Reels. Ketiganya memiliki karakter algoritmik yang menempatkan konten sensasional sebagai komoditas penting untuk mempertahankan engagement. Namun, dalam ekosistem yang bergerak sangat cepat itu, publik justru semakin sulit membedakan mana yang nyata dan mana yang sepenuhnya fabrikasi digital. Artikel ini membahas anatomi ledakan hoaks AI, bagaimana algoritma membuat masyarakat rentan tertipu, serta tiga strategi deteksi yang dapat membantu Generasi Z menjadi konsumen informasi yang lebih tangguh dan skeptis.

Ledakan Hoaks AI di Era Video Pendek

Kemunculan teknologi text-to-video (TTV), image-to-video, dan voice cloning telah mengubah lanskap penyebaran hoaks menjadi semakin industri. Jika deepfake beberapa tahun lalu membutuhkan perangkat keras mahal, proses pengeditan panjang, serta keahlian teknis tingkat lanjut, kini manipulasi video dapat dilakukan hanya dengan menuliskan prompt sederhana. Cukup menuliskan kalimat seperti “tokoh publik A sedang memberikan pidato mengkritik kebijakan tertentu”, maka sebuah video akan muncul dalam hitungan detik dengan visualisasi yang sangat mirip kenyataan. Kemajuan model AI generatif seperti Sora, Runway Gen-3, atau Pika Labs memungkinkan siapa saja menghasilkan narasi visual yang tampak autentik.

Proses ini bekerja dalam dua tahap. Pertama, teknologi text-to-video memungkinkan pengguna mengubah deskripsi teks menjadi video yang tampak profesional. Algoritma akan memetakan elemen visual, membuat latar, mengatur sudut kamera, hingga menciptakan ekspresi wajah yang sesuai dengan teks instruksi. Kedua, voice cloning menyempurnakan manipulasi tersebut dengan meniru suara tokoh publik menggunakan sampel suara yang sangat minim. Penelitian yang diterbitkan dalam jurnal Patterns (2023) menunjukkan bahwa sebagian besar model voice cloning hanya memerlukan 3 hingga 5 detik audio untuk menghasilkan suara tiruan yang presisi.

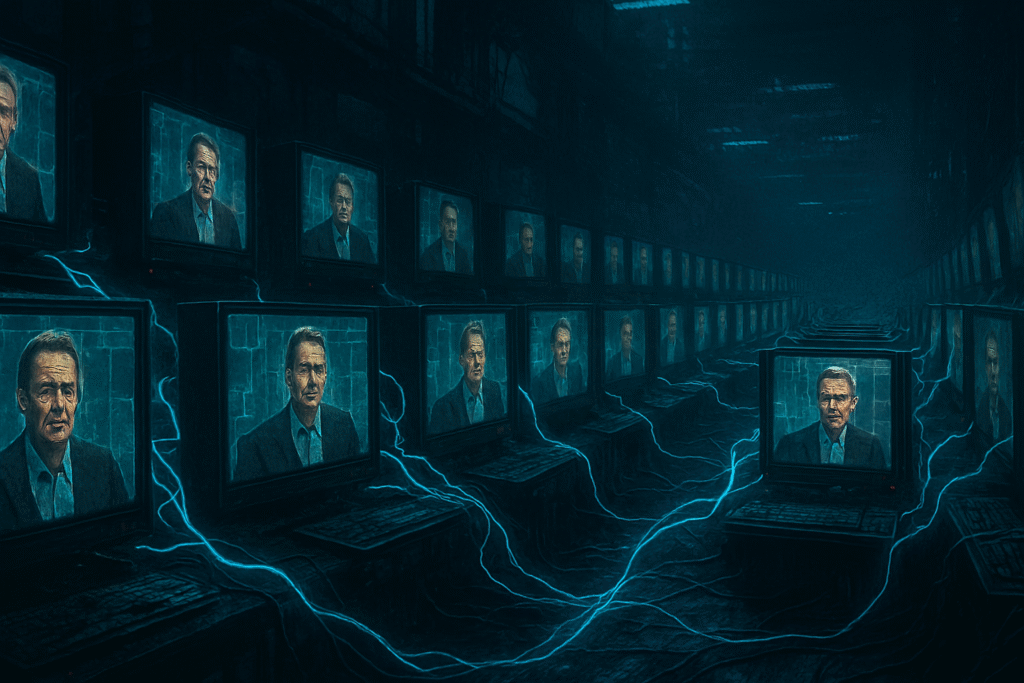

Kedua teknologi ini menjadikan proses pembuatan hoaks tidak hanya lebih mudah dilakukan, tetapi juga dapat direplikasi secara massal. Akun-akun anonim di TikTok dan X/Twitter kini mulai menggunakan model AI untuk memproduksi ratusan video tiap hari, menggunakan skenario berbeda dengan wajah dan suara tokoh yang sama. Mereka bekerja layaknya pabrik—menghasilkan konten sebanyak mungkin untuk memancing emosi, polarisasi, dan penyebaran viral. Beberapa analis media menyebutnya sebagai “Industrial-Scale Disinformation”, fase baru dari perang informasi global.

Kasus pabrikasi video AI telah muncul di berbagai negara. Pada 2024, BBC melaporkan kemunculan video palsu yang menampilkan Perdana Menteri Singapura memberikan pengumuman palsu mengenai kebijakan ekonomi. Pada tahun yang sama, CNN menemukan ratusan akun TikTok yang memproduksi video palsu figur publik AS menjelang masa pemilu. Polanya seragam: konten dibuat cepat, diunggah dalam volume tinggi, dan diarahkan untuk memprovokasi kemarahan atau rasa takut. Situasi ini menunjukkan bahwa hoaks AI bukan lagi ancaman masa depan, melainkan realitas yang sedang berlangsung di depan mata kita.

Cara Kerja Pabrikasi Video AI dan Mengapa Publik Mudah Tertipu

Masyarakat sering kali tertipu bukan hanya karena kemajuan teknologi AI, tetapi juga karena karakteristik psikologis manusia dan desain algoritmik platform media sosial. Ketika video palsu dipadukan dengan algoritma yang memprioritaskan emosi, maka terbentuklah lingkungan digital yang sangat rentan terhadap misinformasi.

Secara teknis, video AI bekerja dengan menyatukan beberapa model generatif. Model pertama bertugas menghasilkan frame visual secara konsisten. Model kedua memprediksi gerakan tubuh dan mimik wajah. Model ketiga mengatur background, pencahayaan, dan dinamika kamera. Ketika digabungkan, ketiganya menciptakan ilusi video yang sangat meyakinkan. Penelitian MIT Technology Review (2023) menunjukkan bahwa model generatif terbaru telah melampaui deepfake tradisional dalam hal stabilitas visual, detail kulit, dan sinkronisasi bibir.

Namun kualitas bukan satu-satunya alasan kita tertipu. Algoritma media sosial—khususnya TikTok dan X/Twitter—memprioritaskan konten yang memicu reaksi emosional cepat. Ketika sebuah video palsu menimbulkan kemarahan, keterkejutan, atau kebingungan, algoritma menganggapnya sebagai sinyal bahwa konten tersebut “relevan” bagi banyak orang. Karena itu, video dengan reaksi emosional tinggi langsung didorong ke lebih banyak pengguna. Semakin banyak reaksi, semakin besar distribusi organiknya. Ini menciptakan lingkaran viral yang tidak membutuhkan verifikasi fakta sama sekali.

Efek psikologis juga memainkan peran penting. Fenomena familiarity effect membuat seseorang lebih mudah percaya pada informasi yang sering ia lihat, bahkan ketika informasi tersebut tidak benar. Jika sebuah video palsu bermunculan berulang kali di linimasa, otak mengasosiasikannya sebagai sesuatu yang benar karena “terlihat familiar”. Selain itu, source blindness—kecenderungan untuk mempercayai konten tanpa melihat sumbernya, menjadi semakin dominan di kalangan pengguna muda. Penelitian Pew Research Center menunjukkan bahwa lebih dari 30% Gen Z mendapatkan berita dari TikTok, dan sebagian besar tidak mengevaluasi kredibilitas sumbernya.

Semua faktor ini menjadikan hoaks AI bukan hanya hasil dari teknologi, tetapi juga hasil dari desain platform dan pola konsumsi informasi masyarakat. Selama video palsu tetap murah, cepat diproduksi, dan mampu memicu emosi, maka penyebarannya akan terus melampaui kemampuan publik untuk memverifikasi.

Mengapa Algoritma Membuat Kita Semakin Rentan

Algoritma video pendek bekerja dengan logika yang sangat sederhana yaitu konten yang memicu emosi cepat dianggap berkualitas tinggi. TikTok menggunakan sistem berbasis interest graph, bukan social graph. Artinya, algoritma tidak peduli apakah Anda mengikuti seseorang, tetapi peduli pada seberapa lama Anda menonton, apakah Anda menonton ulang, dan bagaimana Anda bereaksi terhadap konten tersebut. YouTube Shorts dan Instagram Reels mengikuti jalan yang sama, dengan prioritas pada watch-time, retention, dan komentar.

Dalam struktur seperti ini, video palsu adalah bahan bakar ideal. Video palsu sering kali memuat pernyataan ekstrem, visual mengejutkan, atau situasi yang memancing konflik opini. Hal-hal seperti itu membuat pengguna berhenti scrolling, menonton lebih lama, lalu mengulang, mengomentari, atau membagikannya. Setiap interaksi adalah sinyal positif yang memperkuat distribusi konten tersebut. Dengan demikian, algoritma secara tidak langsung menjadi mesin distribusi hoaks paling efisien yang pernah ada.

Platform-platform tersebut juga menambah lapisan risiko melalui fitur rekomendasi otomatis. Ketika seorang pengguna menonton satu video kontroversial, sistem akan merekomendasikan video serupa dari akun lain, menciptakan lorong informasi yang memperkuat bias. Penelitian dari Cornell University (2023) menyebut fenomena ini sebagai “algorithmic amplification of falsehoods”, yaitu bagaimana algoritma memperbesar penyebaran misinformasi secara eksponensial.

Pada titik ini, kita melihat bahwa ancaman hoaks AI tidak hanya berasal dari teknologi pembuatnya, tetapi dari keseluruhan ekosistem digital yang memfasilitasi penyebarannya. Di sinilah pentingnya kemampuan literasi digital generasi muda untuk mengimbangi kekuatan algoritma.

Strategi Deteksi Video Palsu yang Harus Dikuasai Generasi Z

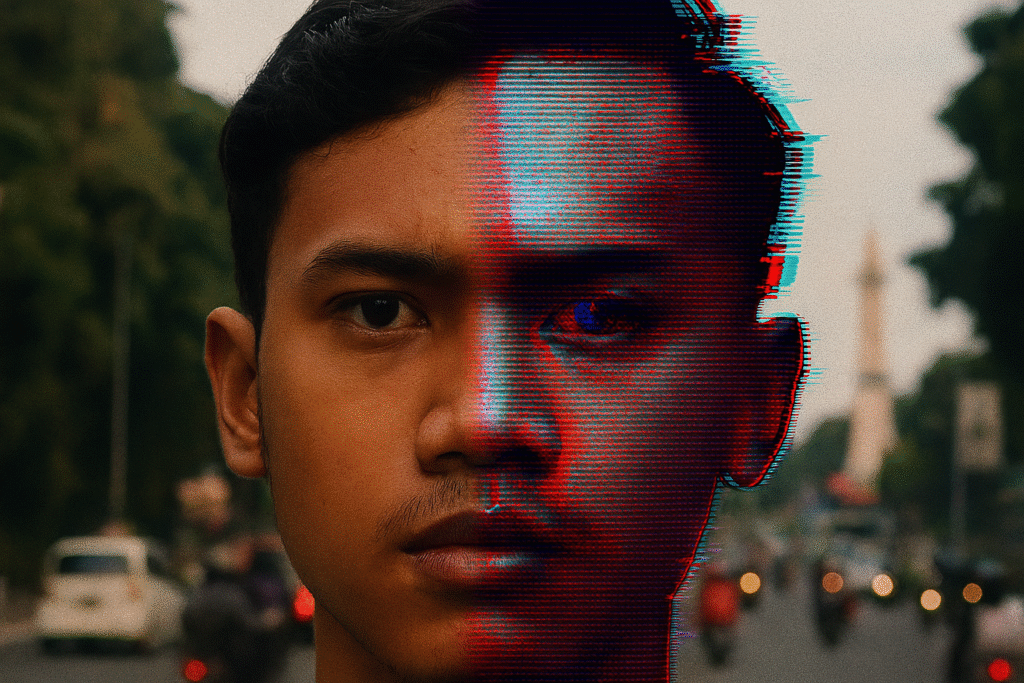

Di tengah banjir video palsu yang semakin sulit dibedakan dari kenyataan, kemampuan mendeteksi manipulasi visual menjadi keterampilan digital baru yang harus dimiliki semua pengguna. Ada tiga strategi utama yang dapat diterapkan oleh Generasi Z agar tidak terjebak dalam jebakan pabrikasi video AI, masing-masing menekankan aspek audio, visual, dan konteks.

Strategi pertama adalah melakukan pemeriksaan mendalam terhadap kualitas audio. Voice cloning adalah salah satu komponen AI yang paling mudah terdeteksi oleh telinga terlatih. Suara hasil kloning sering kali terdengar datar, monoton, atau tidak memiliki keunikan intonasi yang biasanya muncul dalam percakapan manusia asli. Ketidakcocokan sinkronisasi antara suara dan gerakan bibir juga menjadi indikator kuat manipulasi. Walaupun model generatif terus berkembang, audio masih menjadi celah penting yang dapat dimanfaatkan publik untuk mengidentifikasi ketidakwajaran.

Strategi kedua berfokus pada detail fisik dalam video. Model AI masih kesulitan meniru mikro-ekspresi wajah seperti gerakan mata halus, kedipan alami, atau ekspresi spontan yang biasanya muncul dalam interaksi manusia nyata. Video AI sering menunjukkan anomali di sekitar rambut, telinga, dan perbatasan wajah karena sistem kesulitan menggabungkan detail yang sangat kecil dalam gerakan dinamis. Perhatikan pula ketidakkonsistenan pencahayaan atau bayangan yang tidak sesuai dengan arah cahaya. Kejanggalan kecil seperti ini sering menjadi tanda bahwa visual tersebut telah diproduksi oleh mesin.

Strategi ketiga adalah melakukan verifikasi konteks menggunakan sumber eksternal. Jika video tersebut berisi pernyataan penting dari tokoh publik, langkah pertama adalah memeriksa apakah media mainstream kredibel telah mempublikasikannya. Konten bernilai berita tinggi biasanya langsung diliput oleh media arus utama. Selain itu, memeriksa pernyataan resmi melalui kanal resmi seperti situs web, YouTube resmi, atau press release dapat membantu memastikan apakah video tersebut autentik atau hanya manipulasi AI. Verifikasi silang dengan tiga sumber independen dapat memutus rantai penyebaran hoaks secara efektif.

Ketiga strategi ini tidak hanya mencegah publik terjebak dalam misinformasi, tetapi juga membantu menciptakan ruang digital yang lebih sehat. Dengan kemampuan deteksi yang kuat, Generasi Z dapat menjadi barisan terdepan dalam menjaga integritas informasi.

Menjadi Digital Sceptic di Era Pabrikasi AI

Gelombang pabrikasi hoaks AI adalah tantangan informasi terbesar dalam sejarah internet. Ketika teknologi mampu memproduksi visual hiper-realistis dalam skala masif, kemampuan publik dalam menilai kebenaran menjadi taruhan utama. Di era seperti ini, sikap skeptis digital bukan lagi pilihan, melainkan kebutuhan. Generasi Z, sebagai kelompok pengguna yang paling aktif di TikTok, Instagram, dan YouTube Shorts, memegang peran sentral dalam menyaring informasi sebelum membagikannya.

Memahami cara kerja algoritma, melatih kepekaan terhadap detail visual dan audio, serta membiasakan diri melakukan verifikasi lintas sumber adalah fondasi utama untuk bertahan dari serangan hoaks berbasis AI. Ruang publik digital hanya dapat tetap sehat jika penggunanya memilih untuk tidak menjadi corong, melainkan menjadi penapis. Pada akhirnya, pertanyaan yang harus diajukan sebelum menekan tombol share adalah: Apakah ini kenyataan, atau hanya hasil dari sebuah prompt?.